Em um cenário onde a inteligência artificial deixou de ser conceito e virou ferramenta prática, conectar LLMs a informações externas é quase uma necessidade para empresas que buscam ganhar agilidade e reduzir tarefas manuais. O Model Context Protocol (MCP) surge como uma solução aberta e flexível para integrar modelos de linguagem a bancos de dados, APIs e outros sistemas, permitindo criar agentes inteligentes realmente funcionais no dia a dia empresarial.

O MCP muda a forma como IA e sistemas conversam.

Este artigo mostra como o MCP e os modelos da OpenAI podem ser conectados a diferentes aplicações, destacando os ganhos e práticas recomendadas, especialmente para empresas que não querem ficar presas a soluções fechadas. Experiências da Codexa25 ilustram como as integrações estão mais acessíveis do que nunca.

O que é o Model Context Protocol (MCP)

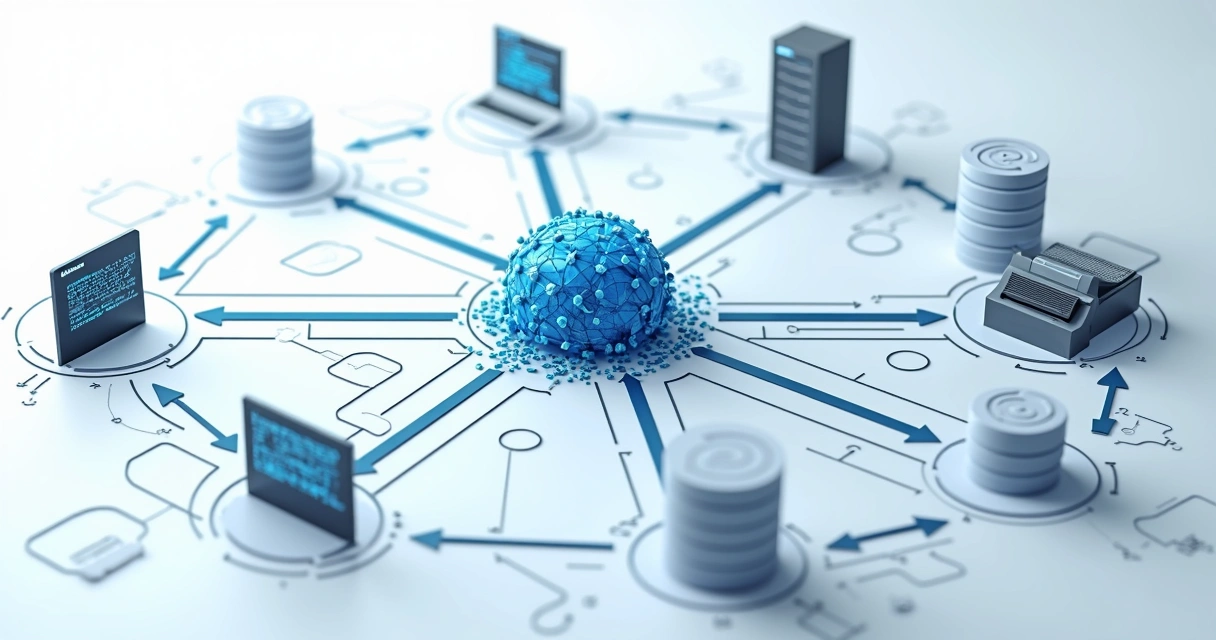

MCP é um padrão aberto, pensado para que modelos de IA, como GPT, por exemplo, possam acessar e manipular dados externos. Não é uma simples ponte: é uma orquestra onde cada instrumento pode falar com todos os outros, sem restrição. Uma API genérica entre LLMs e o mundo real.

O MCP funciona como uma camada de contexto. Ele recebe a requisição do modelo, interpreta o pedido e a encaminha para o serviço desejado, seja um banco de dados, uma API, um sistema legado ou um serviço externo. Depois, filtra, converte e devolve o resultado para o modelo, num formato compreensível e pronto para resposta ao usuário.

Talvez a definição pareça técnica, mas o objetivo do MCP é bem simples: padronizar como os modelos acessam informações externas, evitando reinvenções de roda em cada projeto e abrindo espaço para módulos reaproveitáveis.

Talvez a definição pareça técnica, mas o objetivo do MCP é bem simples: padronizar como os modelos acessam informações externas, evitando reinvenções de roda em cada projeto e abrindo espaço para módulos reaproveitáveis.

Por que o MCP openAI é diferente?

Muitos modelos atuais trazem integrações próprias, mas nem sempre padronizadas ou compatíveis entre si. O MCP OpenAI, no sentido da adaptação do protocolo MCP para o ecossistema OpenAI, se destaca por permitir que seus modelos interajam, de forma padronizada, com diferentes sistemas, fugindo do aprisionamento em abordagens fechadas.

Enquanto soluções proprietárias costumam trabalhar com plugins específicos, o MCP abre portas para interações com múltiplos sistemas, bancos de dados, fluxos HTTP e até softwares antigos, via um único padrão. Isso traz flexibilidade para empresas que querem misturar tecnologias e fornecedores sem ter que reescrever integrações a cada troca.

Como funciona a integração MCP com modelos OpenAI

A integração acontece, basicamente, em três etapas:

- O usuário ou agente de IA faz uma pergunta ou dá um comando

- O modelo identifica que precisa buscar informações externas e aciona o MCP

- O MCP executa a chamada, processa o resultado e devolve resposta ao modelo

Imagine um agente de IA que responde dúvidas internas da empresa e, ao mesmo tempo, consulta faturamento em tempo real. Ele pode recorrer ao MCP sempre que precisar acessar dados do ERP, sem expor o banco diretamente ao modelo.

O protocolo se torna o tradutor universal entre IA e qualquer fonte de dados.

Cenários práticos: integrando LLMs a sistemas corporativos

Como o MCP viabiliza a conexão de LLMs a múltiplos sistemas, as possibilidades são praticamente infinitas. Alguns exemplos que já implementamos na Codexa25:

- Consultas a banco de dados: O MCP recebe o comando "listar os 10 maiores clientes deste mês", traduz para uma query segura, executa no banco e retorna os dados formatados para o modelo.

- Integração com sistemas legados: Automação de processos em sistemas antigos sem API moderna é possível, já que o MCP pode receber comandos HTTP, fazer web scraping seguro ou acionar scripts específicos.

- Busca em documentos: O modelo requisita informações em PDFs ou planilhas, o MCP lê, resume e devolve só o que interessa.

- Interações multi-agente: Diferentes LLMs, cada um com uma especialidade, podem usar o MCP para colaborar de forma coordenada, trocando dados em tempo real.

Opções de implementação: servidores, APIs e fluxos HTTP

O MCP pode ser implementado de formas variadas, sem exigir infraestrutura complexa:

- Servidores MCP dedicados: Uma instância roda como “ponte” entre o modelo e o sistema. Ideal para empresas que querem isolar o trânsito de dados e gerenciar permissões com cuidado extra.

- Integração via API: O modelo faz um POST para o endpoint MCP, que por sua vez dispara a rotina no sistema desejado. Ótimo para operações assíncronas ou para soluções low-code.

- Fluxos HTTP e automações (tipo n8n): Ferramentas de automação orquestram chamadas via MCP, disparando tarefas ou consultas conforme a demanda do agente IA.

Nenhuma dessas abordagens é exclusiva; muitas empresas combinam duas ou mais para equilibrar segurança, performance e facilidade de manutenção.

Integração com bancos de dados e sistemas legados

Empresas ainda dependentes de sistemas antigos, sem API pública, encontram no MCP uma forma de integrar sem recorrer a soluções improvisadas ou arriscadas. Por meio de scripts intermediários ou mesmo wrappers de WebSocket/HTTP, o MCP faz a ponte e garante que dados confidenciais circulem com monitoramento e rastreabilidade.

Exemplo prático: consulta ao ERP

Imagine um colaborador precisando saber o status de um pedido. Ao digitar a pergunta para o chatbot interno, o modelo dispara um comando via MCP. Este, por sua vez, faz a consulta no ERP, formata a resposta e envia ao modelo, que responde ao colaborador em segundos. Sem complicação, sem abrir acessos desnecessários ao banco.

Automação real não é luxo, é necessidade para quem quer crescer.

Benefícios do MCP openAI para empresas

Ao escolher o MCP como padrão de comunicação, as empresas ganham em vários níveis:

- Modularidade: Cada integração é um “bloco” independente. Mudou o sistema? Não precisa refazer toda a ponte.

- Interoperabilidade: Funciona bem com diferentes modelos e fornecedores, minimizando dependência de uma única tecnologia.

- Escalabilidade: À medida que o negócio cresce, basta adicionar novos conectores, sem retrabalho na arquitetura.

- Simplificação: Uma única documentação, menos rotinas paralelas e menos código para dar manutenção.

- Segurança aprimorada: O acesso é monitorado e centralizado, reduzindo chance de vazamentos ou usos não autorizados de dados.

Diferenças entre MCP e abordagens proprietárias

Abordagens proprietárias, como plugins fechados, impõem limitações de interoperabilidade e flexibilidade. O MCP, por ser aberto, permite que múltiplos modelos, inclusive da OpenAI, operem juntos, acessem os mesmos dados e colaborem em fluxos complexos.

Além disso, ambientes multi-modelo, cada vez mais presentes nas empresas, só são viáveis se houver um protocolo neutro, sem preferências por fornecedor ou tipo de sistema. O MCP amplia as possibilidades: um modelo pode buscar dados em diferentes bancos, outros podem processar informações ou executar tarefas variadas, sempre seguindo o mesmo padrão.

Com o MCP, sua IA deixa de ser uma caixa preta e vira parte do time.

Boas práticas: configuração, escolha de ferramentas e segurança

Integrar bem não significa apenas “fazer funcionar”. Algumas dicas que aprendemos em projetos como os da Codexa25 fazem diferença:

- Mapeie os fluxos de dados: Saiba que informações o modelo acessa e por qual caminho transitam. Ajuda a detectar gargalos ou riscos.

- Gerencie permissões com cuidado: Não abra tudo para todos os agentes. Crie tokens ou chaves específicas para cada processo.

- Monitore logs e acesso: Tenha registro do que foi solicitado, por quem e o que foi retornado. Isso evita surpresas desagradáveis.

- Atualize o protocolo quando necessário: O MCP evolui. Acompanhe a documentação e atualize conectores para receber melhorias ou correções.

- Prefira conectores mantidos pela comunidade: Eles costumam ser melhor testados e mais seguros.

Ferramentas de automação, como n8n e similares, também podem servir de interface para orquestrar fluxos MCP em rotinas do dia a dia. Muitas vezes, o segredo está em experimentar pequenas automações, evoluindo em ciclos curtos de entrega, como fazemos na Codexa25.

Conclusão

A adoção do MCP OpenAI e sua integração com modelos de linguagem representa um passo natural para qualquer empresa interessada em automação inteligente e colaboração entre IA e humanos. A padronização trazida pelo protocolo facilita o crescimento, reduz custos ocultos e abre espaço para inovações rápidas, tudo sem sacrificar segurança ou jogando fora os investimentos já feitos em sistemas internos.

Se sua empresa quer construir soluções práticas, adotar automação com IA ou criar conectores flexíveis de verdade, fale com a equipe Codexa25. Temos experiência de ponta a ponta, do protótipo ao acompanhamento do projeto, tudo sem mistério e com código limpo.

Perguntas frequentes sobre MCP OpenAI

O que é a integração MCP OpenAI?

A integração MCP OpenAI é o uso do Model Context Protocol para conectar modelos de linguagem da OpenAI (como GPT) a dados externos, bancos de dados e ferramentas corporativas, usando um padrão aberto que facilita a troca de informações e automação de tarefas.

Como posso usar MCP com OpenAI?

Você pode usar MCP com modelos OpenAI criando um servidor MCP, integrando via APIs REST ou usando ferramentas de automação que fazem ponte entre seu agente de IA e sistemas externos. Assim, os modelos acessam e manipulam dados de forma padronizada e segura.

Quais são as principais vantagens do MCP OpenAI?

O MCP OpenAI traz modularidade, permitindo integrar múltiplos sistemas sem dependência de soluções proprietárias. Ele facilita escala, promove interoperabilidade entre diferentes modelos e simplifica o controle de segurança e monitoramento de acesso a dados.

MCP OpenAI é compatível com quais ferramentas?

O MCP é compatível com um grande leque de ferramentas, incluindo bancos de dados SQL, APIs REST, sistemas legados (via scripts ou integrações customizadas), além de plataformas de automação como n8n. A lista cresce conforme a comunidade propõe novos conectores.

Quanto custa implementar MCP OpenAI?

O custo depende da complexidade da integração e das ferramentas envolvidas. Projetos menores podem ser implementados com baixo investimento, principalmente aproveitando soluções open source. Para integrações mais robustas ou de missão crítica, é comum envolver consultorias especializadas como a Codexa25 para garantir qualidade e suporte contínuo.